如何在本地部署DeepSeek Janus Pro?

作者:啊哈哈哈 来源:08论坛 时间:2025-03-19 16:42:56

DeepSeek发布的Janus-Pro-7B是一款开源多模态大模型,支持图像识别和生成,性能超越Openai的DALL·E 3。以下是DeepSeek Janus Pro-7B如何在本地部署的详细步骤、技巧及注意事项:

一、环境准备

硬件要求

GPU:显存 ≥24GB(推荐 NVIDIA RTX A6000 或更高性能显卡);若显存不足,可尝试低精度模式(model.half())或减小生成参数。

存储空间:≥30GB 可用空间(模型文件约 20GB+)。

操作系统:推荐 Ubuntu 20.04+ 或 Windows(需适配 CUDA)。

Python:3.8+,建议使用 Conda 管理虚拟环境。

软件依赖

CUDA:11.7+(需与 PyTorch 版本匹配)。

PyTorch:指定版本 torch==2.0.1+cu117(需通过官方索引安装)。

其他工具:Git、HuggingFace Hub 下载工具(huggingface-cli)。

二、部署步骤

1. 克隆代码库

gitclonehttps://github.com/deepseek-ai/Janus.gitcdJanus2. 创建虚拟环境

condacreate-njanuspython=3.8-ycondaactivatejanus3. 安装依赖

pipinstalltorch==2.0.1+cu117--index-urlhttps://download.pytorch.org/whl/cu117pipinstall-rrequirements.txtpipinstall-e.[gradio]#安装Gradio扩展4. 下载模型

方法一:通过 huggingface-cli 下载完整模型(推荐国内用户使用镜像加速):

HF_ENDPOINT=https://hf-mirror.comhuggingface-clidownloaddeepseek-ai/Janus-Pro-7B--local-dir./models/Janus-Pro-7B--resume-download--cache-dir./cache方法二:手动从 HuggingFace 仓库 下载模型文件并解压至 ./models/Janus-Pro-7B。

5. 启动应用

文本交互界面:

python demo/app_text.py --model-path ./models/Janus-Pro-7B

多模态界面(支持图像生成与问答):

python demo/app_multimodal.py --model-path ./models/Janus-Pro-7B --port 7860

访问 http://localhost:7860 或 http://127.0.0.1:7860 使用交互界面。

三、功能使用示例

文生图(Text-to-Image)

fromjanus.utilsimportgenerate_imagegenerate_image(model_path="./models/Janus-Pro-7B",prompt="夕阳下的雪山,山脚下有蓝色的湖泊",output_dir="./outputs",num_images=4#生成4张图)多模态问答(Visual QA)

fromjanus.modelsimportMultiModalityCausalLM,VLChatProcessorprocessor=VLChatProcessor.from_pretrained("./models/Janus-Pro-7B")model=MultiModalityCausalLM.from_pretrained("./models/Janus-Pro-7B").to("cuda")#输入对话与图片路径conversation=[{"role":"","content":"描述这张图片的内容","images":["sample.jpg"]},{"role":"","content":""}]inputs=processor(conversations=conversation)outputs=model.generate(**inputs)print(processor.decode(outputs[0]))四、常见问题与优化

显存不足

减小生成参数:max_new_tokens=256。

启用低精度模式:model = model.half()。

下载速度慢

使用国内镜像源:HF_ENDPOINT=https://hf-mirror.com。

开启多线程下载:--workers 8。

依赖冲突

严格安装指定版本:

pip install transformers==4.33.2

图像生成质量优化

调整 CFG 权重(5-7 范围内)。

增加并行采样数量:parallel_size=16。

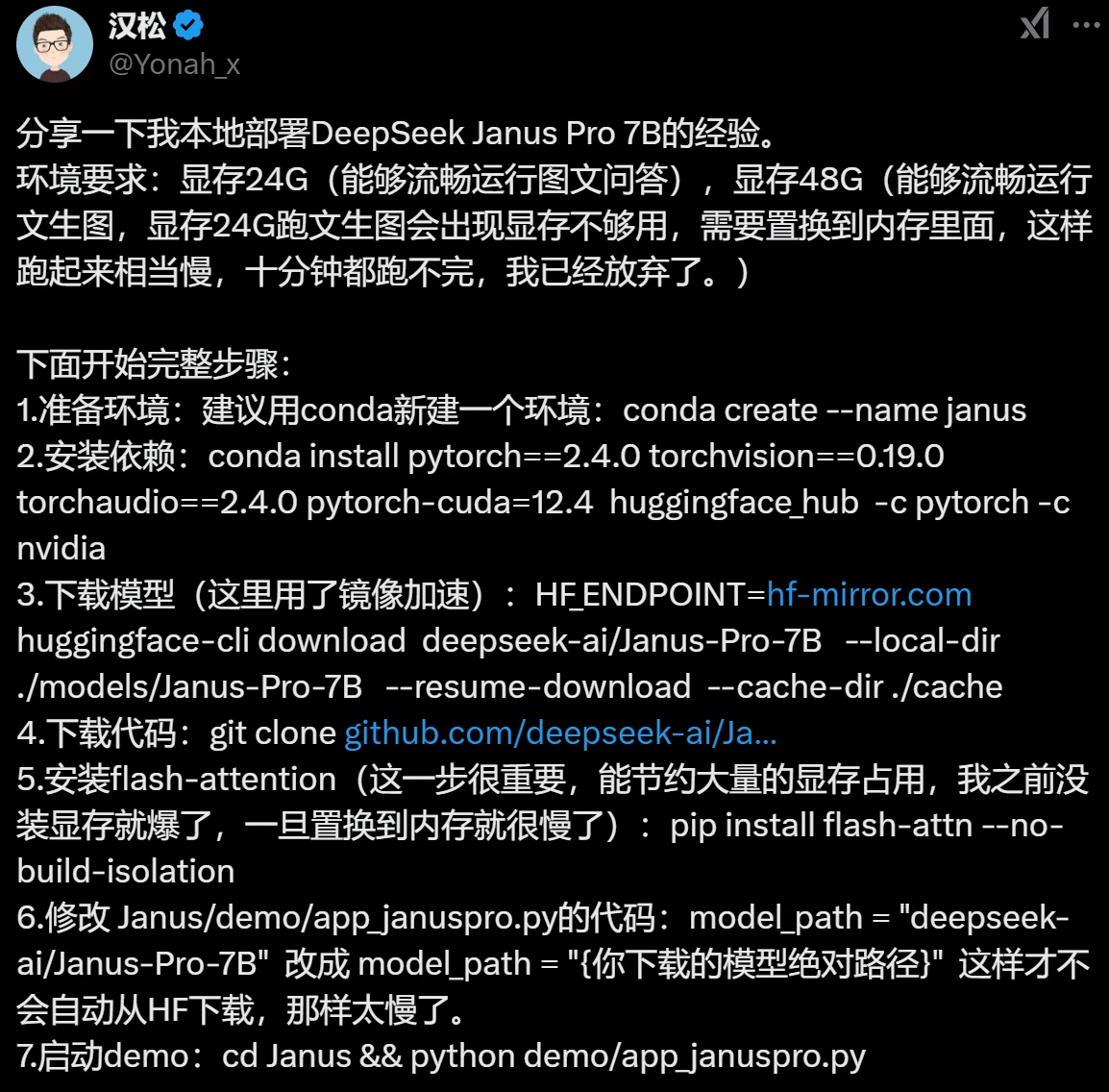

这里也分享X上一位我关注的技术员的本地部署方法:

小技巧:

技巧1:如果你之前已经装过conda的pytorch环境了,可以用 conda create --name myenv --clone base 直接克隆一个,不然每次重新下载pytorch很慢,浪费时间。

技巧2:一定要装flash-attention,虽然不装也能运行,但是显存会爆,有A100的可以忽略。

通过以上的步骤,你就可在本地快速部署并体验 Janus-Pro-7B 的多模态能力了。如需进一步优化或了解模型细节,可参考 GitHub仓库 和 技术文档。

- 上一篇: 如何用Ollama安装DeepSeek?

更多资讯

热门文章

推荐对话

换一换- 人气排行

- 1 如何在本地部署DeepSeek Janus Pro?

- 2 如何用Ollama安装DeepSeek?

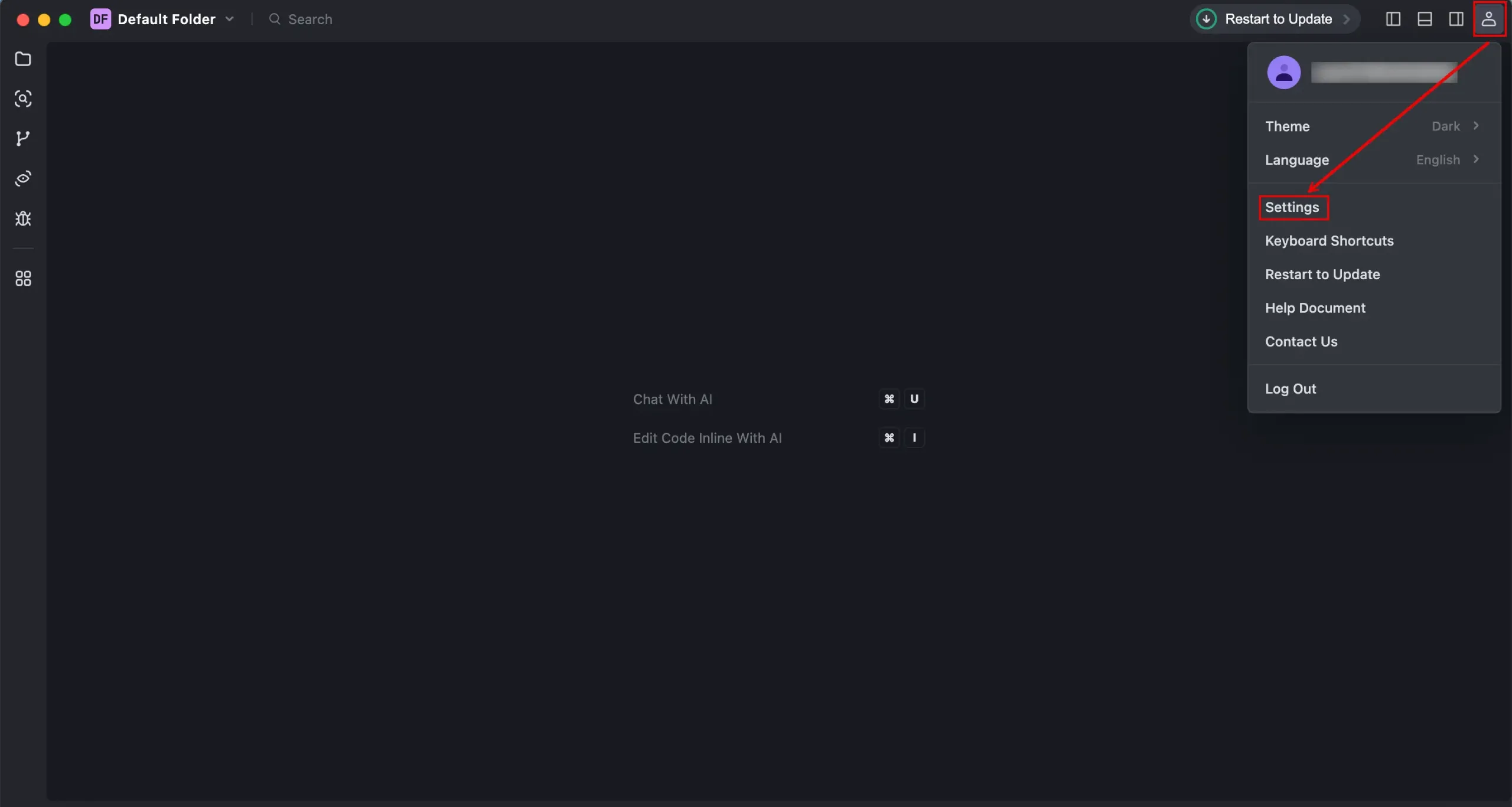

- 3 字节Trae教程:IDE设置方法

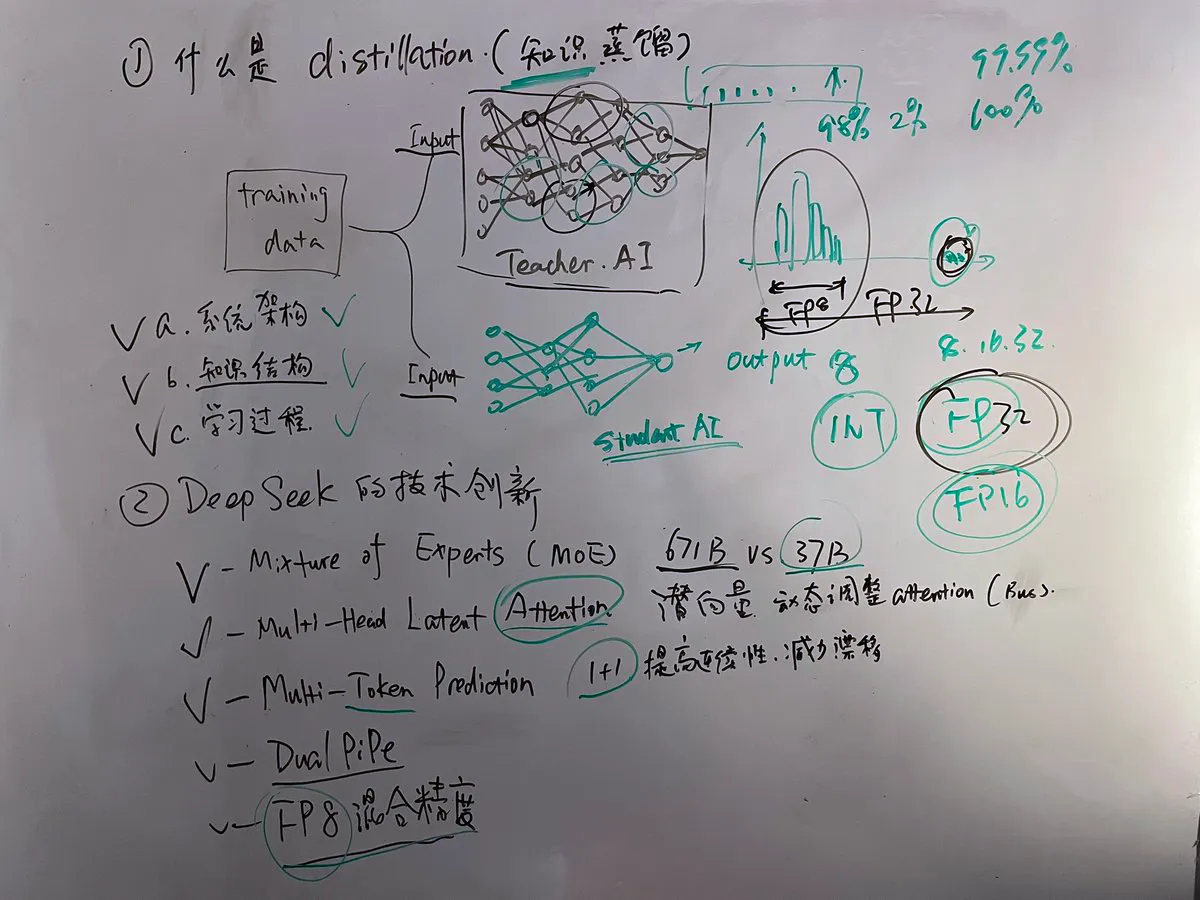

- 4 什么是大模型的蒸馏(distillation),DeepSeek遭遇的“模型蒸馏”指控是怎么回事?

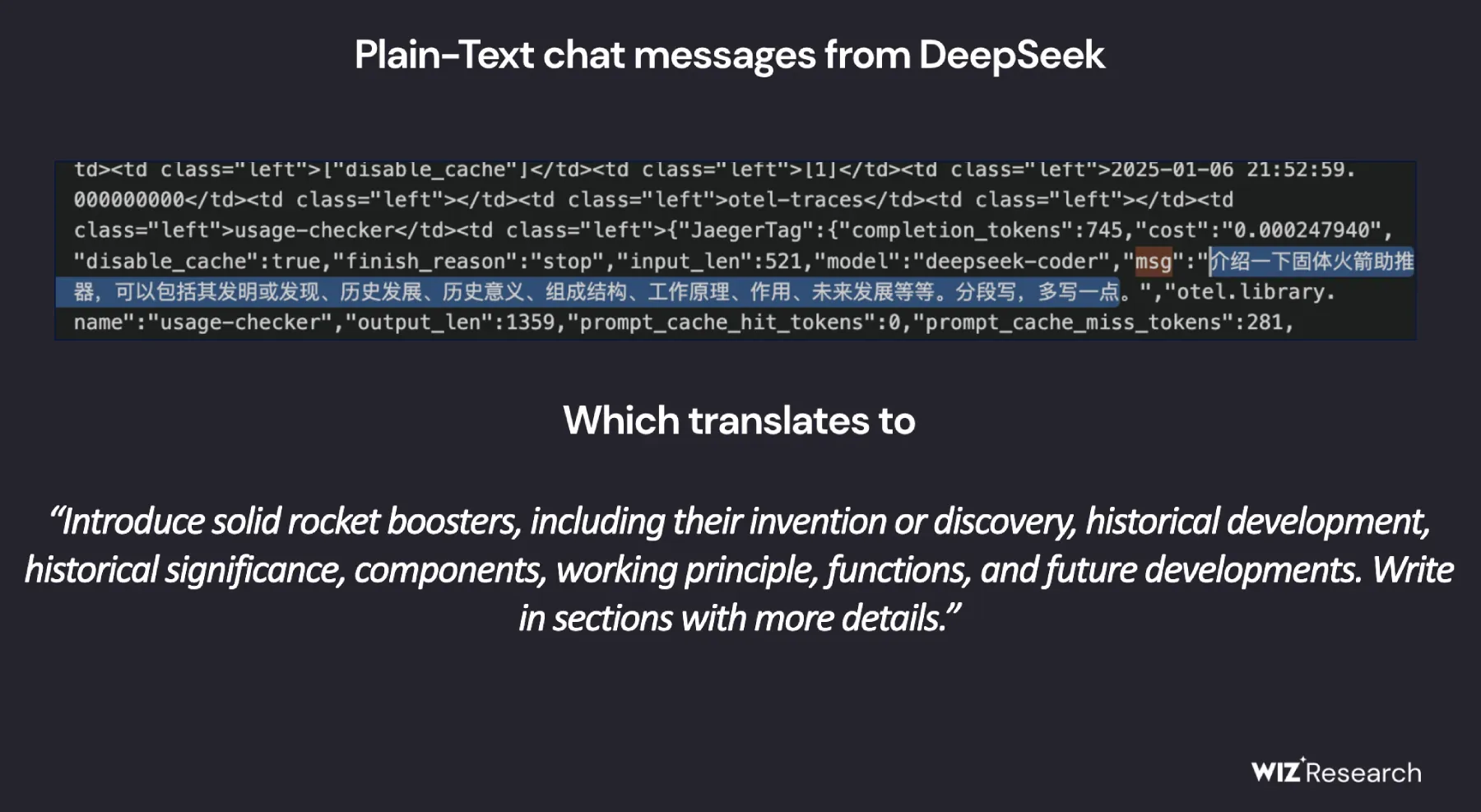

- 5 DeepSeek数据库泄露:包含聊天记录、密钥、后端等敏感的信息被泄露

- 6 Missionl AI发布Mistral Small 3,仅 24B 参数,但性能可匹敌 70B 级别模型

- 7 2025蛇年春节期间最新AI新闻

- 8 Gemini 2.0 Flash已在Google AI Studio和Vertex AI平台正式上线

- 9 OpenAI发布新的推理模型:O3-Mini和O3-Mini-High

- 10 微软、亚马逊、英伟达等服务商宣称已接入Deepseek R1