Open-LLM-VTuber:一个开源的具有手势和语音交互功能的AI虚拟形象

作者:啊哈哈哈 来源:08论坛 时间:2025-04-15 15:49:59

Open-LLM-VTuber是什么?

Open-LLM-VTuber是一个开源的语音交互式 ai 虚拟形象,支持实时语音对话、视觉感知以及 Live2D 动画形象,并且可以完全离线运行。它支持 Windows、macOS 和 Linux 系统,并提供了丰富的功能和高度的可定制性。

Open-LLM-VTuber功能亮点

跨平台支持:支持 Windows、macOS 和 Linux 系统,适配英伟达和非英伟达 GPU,支持 CPU 运行或云 API 调用。

离线模式:完全离线运行,使用本地模型,确保隐私安全。

实时语音对话:支持免提语音交互,用户可以通过语音与虚拟主播进行自然流畅的交流。

视觉感知:能够捕捉用户的面部表情变化以及环境中的光线、色彩等动态信息。虚拟主播会根据感知数据作出动态反应,例如用户微笑时,虚拟主播也会回以笑容。

Live2D 虚拟形象: 使用 Live2D 技术,虚拟主播的表情和动作极为逼真,从细微的眨眼、挑眉到肢体摆动都栩栩如生。

长期记忆:轻松回顾过往对话,内置 Mem0、EVI 等多种记忆模块,还能通过简单接口快速接入自定义记忆系统。

高级交互功能:

支持视觉感知(摄像头、屏幕录制和截图)。

语音打断功能(无需耳机,AI 不会听到自己的声音)。

触摸反馈和 Live2D 表情支持。

宠物模式(透明背景、全局置顶、鼠标穿透)。

AI 主动说话、内心 OS 显示和聊天记录持久化。

广泛的模型支持:

大语言模型(LLM):支持 Ollama、OpenAI、Gemini、Claude 等。

语音识别(ASR):支持 sherpa-onnx、FunASR、Whisper 等。

语音合成(TTS):支持 MeloTTS、Coqui-TTS、Edge TTS 等。

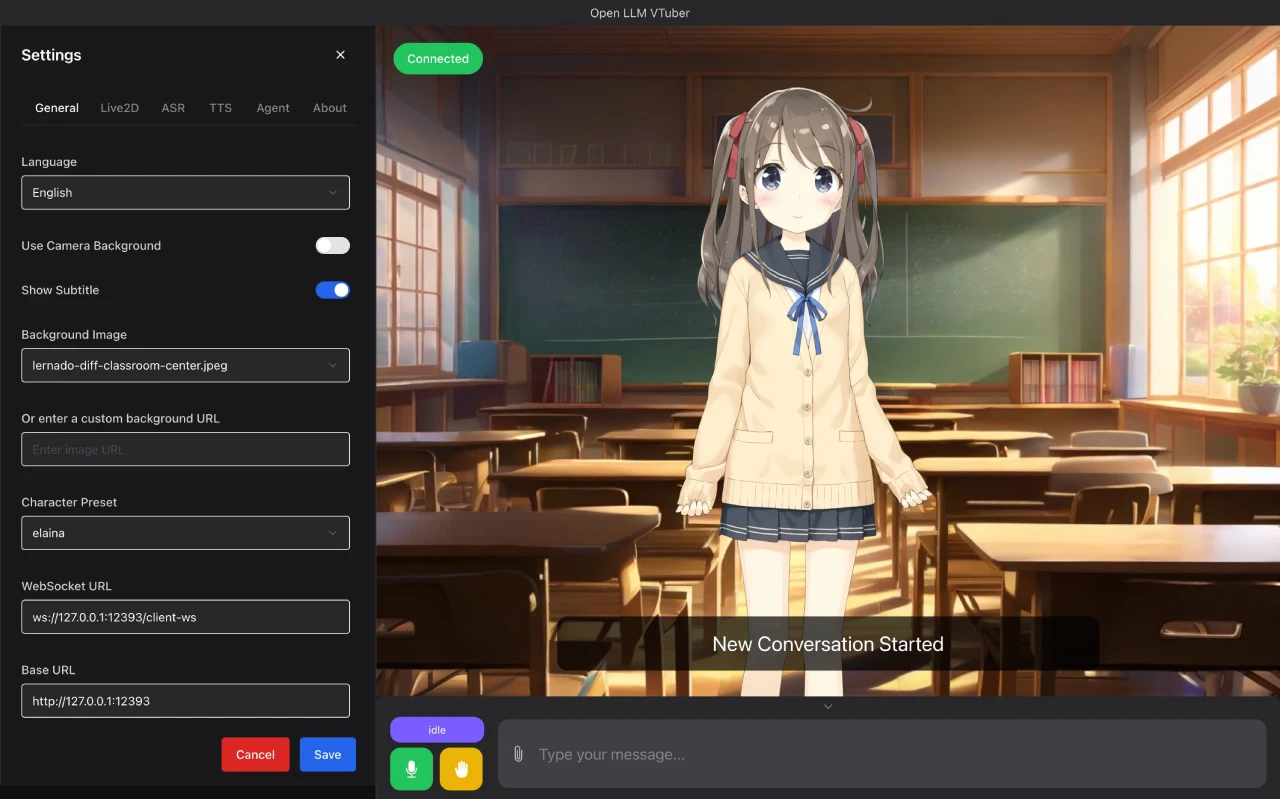

高度可定制:

支持导入自定义 Live2D 模型、修改 Prompt 和音色克隆。

模块化设计,通过简单的配置文件修改来切换各种功能模块。

Agent自由实现:继承并实现 Agent 接口,接入任何架构的 Agent,如 HumeAI EVI、OpenAI Her、Mem0 等。

Open-LLM-VTuber应用场景

直播互动:可以通过自定义虚拟主播形象用于娱乐直播,吸引观众并提供互动体验。

虚拟助手:作为个人虚拟助手,提供信息查询、日程管理等功能。

聊天伴侣:用户可以根据自己的需求打造专属的虚拟伴侣,如虚拟女友、男友或宠物。

创意内容创作:用于制作个性化视频、动画等。

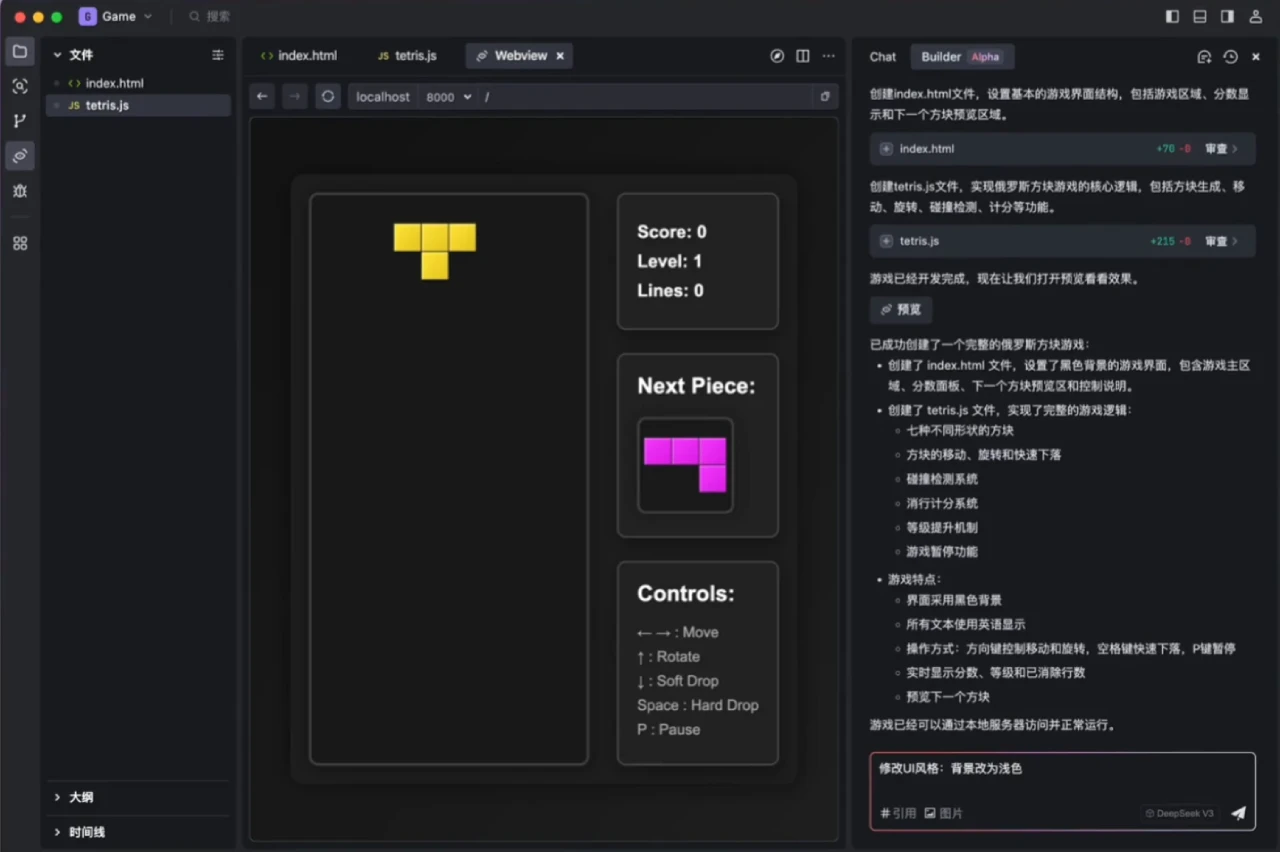

Open-LLM-VTuber使用方法

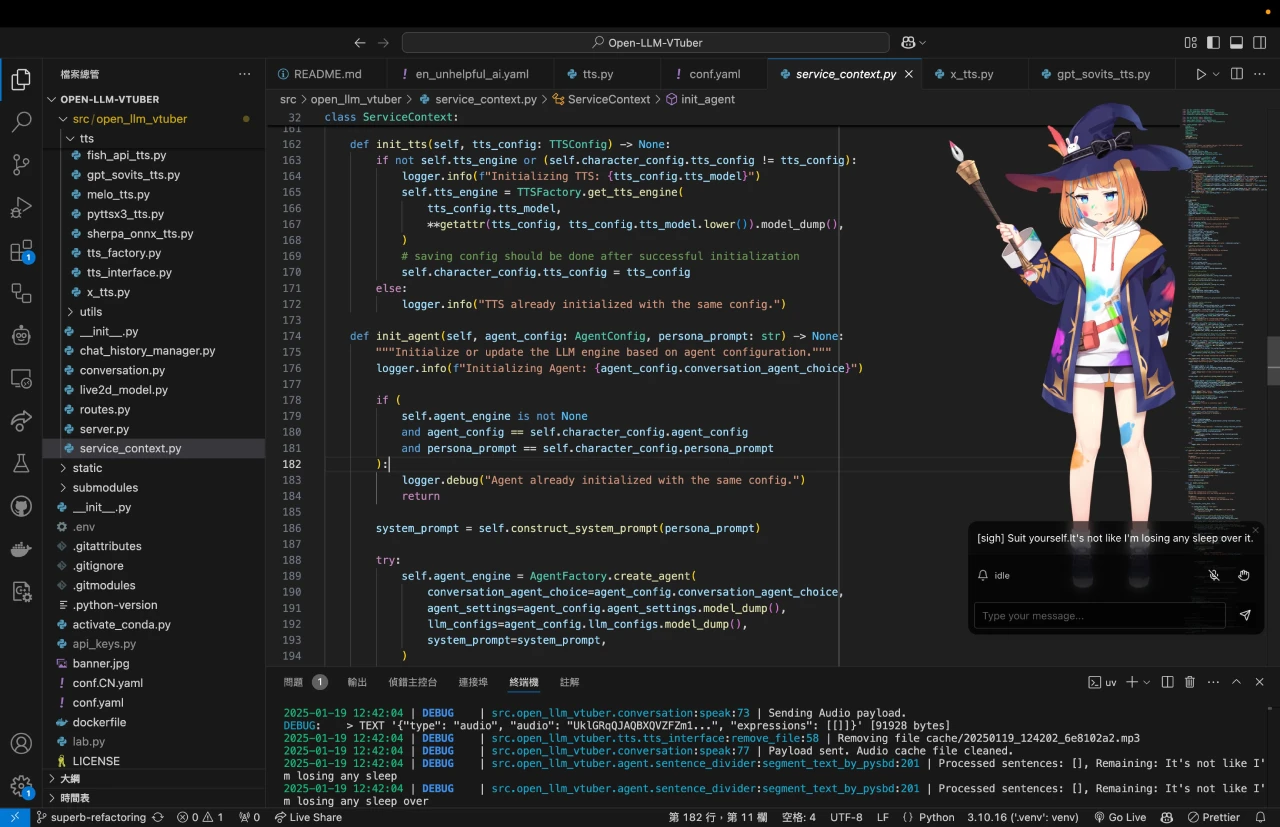

1. 本地部署:

克隆项目代码并安装依赖。

配置 conf.yaml 文件,选择所需的 LLM、ASR 和 TTS 模型。

使用命令行工具(如 uv)运行项目。

2. 更新与卸载:

使用 uv run update.py 进行更新。

卸载时需清理项目文件夹及可能的缓存路径。

3. 客户端使用:

提供网页版和桌面客户端,支持窗口模式和桌宠模式。

支持多语言对话和 TTS 翻译。

Open-LLM-VTuber实现技术

语音识别(ASR):支持多种开源和商业 ASR 引擎。

大语言模型(LLM):支持多种主流 LLM,推理后端可灵活切换。

语音合成(TTS):支持多种 TTS 技术,提供个性化语音合成。

Live2D 集成:使用 Live2D SDK 实现虚拟形象的动态渲染。

模块化设计:支持自定义模块扩展,方便开发者集成新的功能。

项目官网:https://docs.llmvtuber.com/

GitHub仓库地址:https://github.com/Open-LLM-VTuber/Open-LLM-VTuber

更多资讯

热门文章

推荐对话

换一换- 人气排行

- 1 Open-LLM-VTuber:一个开源的具有手势和语音交互功能的AI虚拟形象

- 2 OpenManus:开源版Manus,无需邀请码

- 3 阿里巴巴AI视频生成模型通义万相Wan上线官网:Wan.Video

- 4 Mistral OCR:最强文档识别OCR模型,精确提取各种复杂文档,同类速度最快

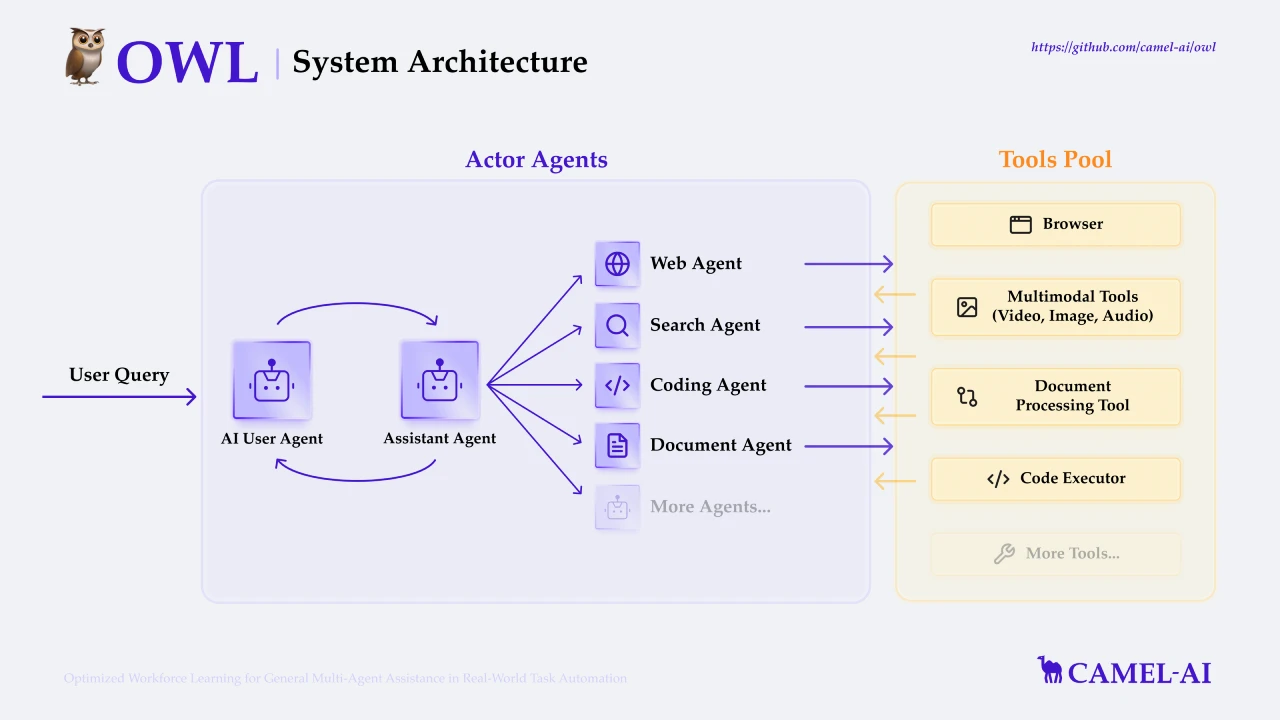

- 5 OWL:CAMEL-AI开源的通用多智能体,复刻并超越Manus

- 6 autoMate:一款AI驱动的本地自动化工具,让电脑自己干活

- 7 Easydict:一个简洁优雅、开源的macOS词典翻译应用

- 8 SpeakerKit:可以快速、高效地识别音频中的不同说话人

- 9 Local-NotebookLM:开源的本地版NotebookLM,能够将PDF转换为播客

- 10 字节跳动的Trae和豆包MarsCode有什么区别,哪个更适合?